M2 Internship and PhD Subjects - Florence Dupin de Saint-Cyr -- Bannay - Univ. Toulouse III

*The internship period should be associated to a financial suport (excepted if you have a CIMI fellowship program). The financial suport can be obtained from the EDMITT doctoral school and from CIMI and according to the case from ADRIA research team.

The long term aim of this project is to be able to predict the reaction of a human user

in presence of an argument: will he/she accept or reject it? We have already proposed

a computational cognitive model of argument acceptance based on

the user profile (knowledge base, association rules, interest, attention etc.) and its

reasoning process. Our research hypothesis, based on the dual process theory,

assumes that the reasoning is done on two levels: on one hand we have the crisp

logical based reasoning and on the other the less crisp association based reasoning.

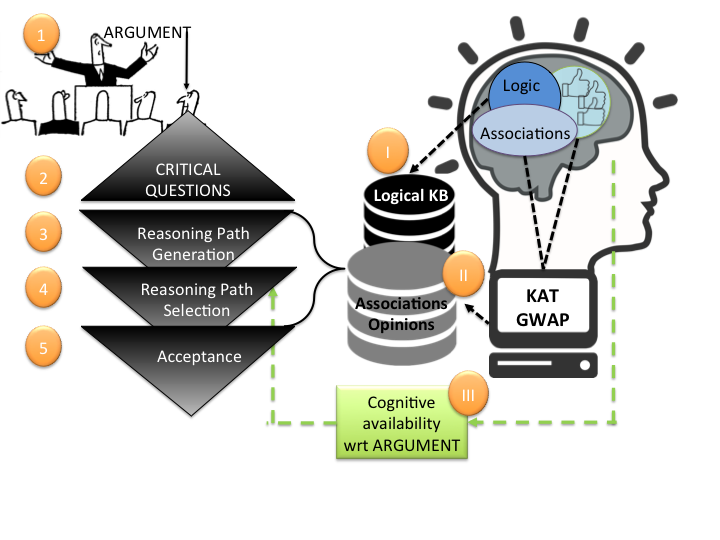

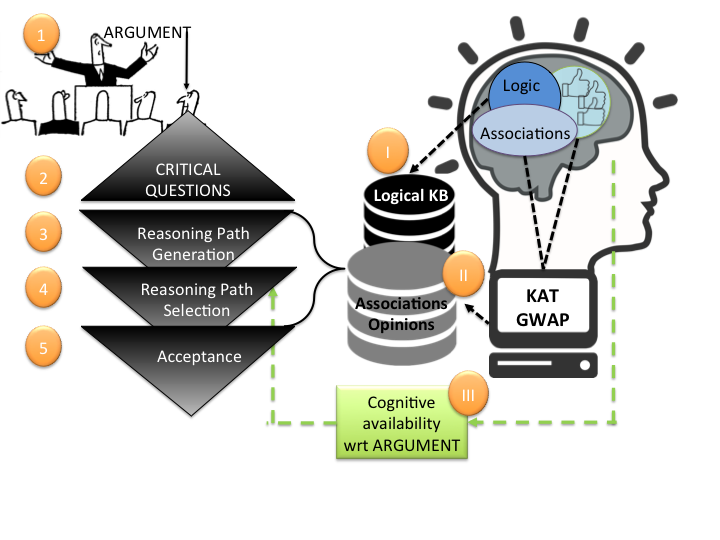

More precisely, our cognitive model of agent acceptance is described on the Figure bellow:

On the right hand side of this Figure we consider a human agent having its

logical knowledge base (with factual observations about the world and generic

statements such as Miradoux is a wheat variety, wheat contains proteins), its

own associations (proteins are related to nutrition) and its opinions (I like

Miradoux, I don’t like spoiled wheat). The logical knowledge is stored as a logical knowledge

base (I, in the Figure) expressed in Datalog+/- (for re-utilisability purpose).

The associations (II) (that can relate two pieces of information as well as a piece

of information to an appreciation—in that case it is called opinion) are more

difficult to elicit and are not often handled in the literature. One of the main

difficulties is that the associations depend on the profile of the person

(expert, non-expert, etc.).

A third parameter is also required by our model, namely, the cognitive

availability (abbreviated ca) of the agent (III) which depends on the agent’s interest

about the particular argument and on the amount of attention he has to spent (its

precise definition is not studied here, it may be based on the agent mood, her

knowledge, sometimes on the speaker, on the topic of the argument, etc.). This

cognitive availability is a parameter that we use to filter the possible reasoning the

agent is able to do.

On the left hand side of the figure, we show the proposed process of

argument acceptance using the cognitive model. When the agent

hears a new argument [step (1)], a number of critical questions are fired [‘‘is the

premise of the argument correct?’’, ‘‘do I agree with the conclusion?’’, ‘‘can I infer

is the premise of the argument correct?”, “do I agree with

the conclusion?”, “can I infer the conclusion from the premise based on what

I know?” - step (2)).

Thanks to the proposed cognitive model, it will then be possible to compute

reasoning paths (i.e. sequences of logical rules and association rules constituting a chain of inferences that leads to a desired conclusion) for each critical

question (step (3)). For a reasoning path we introduce the notion of effort

(cognitive effort to use the rules of the reasoning path) which is confronted

to the cognitive availability of the agent. An association is usually effortless

while logical reasoning is considered as more expensive. The cognitive availability of the agent allows us to have an upper bound of the effort the agent

is able to put into her reasoning paths. The reasoning paths will be selected

based on the effort needed to carry on (step (4)). Based on this selection we

can accept or reject an argument. Note that the reasoning paths are

constructed from the logical knowledge base and the associations

that computationally represent the knowledge of the expert.

Références:

- Pierre Bisquert, Madalina Croitoru, Florence Dupin de Saint-Cyr, Abdelraouf Hecham. Formalizing Cognitive Acceptance of Arguments: Durum Wheat Selection Interdisciplinary Study. In : Minds & Machines, Springer, February 2017 (to appear).

- Pierre Bisquert, Madalina Croitoru, Florence Dupin de Saint-Cyr, Abdelraouf Hecham. Substantive irrationality in cognitive systems (short paper). In : European Conference on Artificial Intelligence (ECAI 2016), La Hague, Hollande, 29/08/16-02/09/16, Maria Fox, Gal Kaminka (Eds.), IOS Press, pp. 1642-1643, 2016.

- Pierre Bisquert, Madalina Croitoru, Florence Dupin de Saint-Cyr, Abdelraouf Hecham. Towards an Understanding of Human Persuasion and Biases in Argumentation. In : Cardiff Argumentation Forum, Cardiff UK, 06/07/16-07/07/16, Federico Cerutti , Francesca Toni (Eds.).

The aim is to develop a computational cognitive model for argument acceptance based on the dual model system in cognitive psychology.

Encadrement : Florence Bannay avec la collaboration éventuelle de collègues Montpelliérains

La transmission d’idées passe principalement à ce jour par le langage écrit. Ce dernier répond à des règles syntaxiques et grammaticales, à un sens de lecture des mots qui constituent des phrases. Au-delà de ce mode linéaire, même s’il permet la complexité et la subtilité des idées communiquées, il existe des types de représentations plus axées sur la spatialisation de graphiques, éventuellement sur un support interactif, ou sur une approche combinant une vue globale vers des niveaux de détail.

Nous avons commencé une étude comparative de différentes représentations de la connaissance (cartes mentales, graphes conceptuels, frises chronologiques, diagrammes de Venn, cartes géographiques...). Nous souhaitons étudier les caractéristiques de ces représentations (ce qui les rend efficaces, lisibles, les conventions qu’elles utilisent, les types de données et d’informations qu’elles permettent de manipuler, etc.). Nous désirons construire les bases d’une grammaire visuelle qui tiendrait compte de notre perception visuelle en utilisant l'intelligence artificielle pour la modélisation, le raisonnement et le contrôle de la structuration cohérente des idées exprimées au travers d’attributs visuels.

L'objectif pratique de ce stage serait de développer un outil permettant l'affichage et le raisonnement dans ce nouveau langage. L'objectif théorique serait d'avancer sur la formalisation des propriétés caractéristiques de ce langage.

Encadrement : Florence Bannay, Denis Parade

Encadrants: Florence Bannay et Romain Guillaume

On s'intéresse au développement d'un nouveau cadre (appelé "BLA") pour la décision dans le cas

d'information incomplète et distribuée. Ce cadre est un graphe bipolaire

d'arguments en faveur ou contre une décision construit à l'avance par consensus

par un groupe d'agents. Une fois qu'il est construit il peut être utilisé par

les agents en présence d'un nouveau contexte. Les agents décrivent ce qu'ils

savent et le cadre de décision instancié par ces connaissances permet de

conclure de façon transparente. Le problème de cette approche est la

construction consensuelle de cette structure.

On propose plusieurs directions d'investigations:

- opérations de manipulation d'un BLA

- zoom/dézoom sur la structure: il s'agirait d'étendre l'expressivité de

cette structure en introduisant la possibilité de raffiner la vision des

arguments (par

l'utilisation d'ontologies) ou des liens entre arguments (grace à

l'utilisation de la spécificité ou de relations par défaut) ou encore des

buts du problème de décision (filtrer les buts sans évoquer les déclencheurs

associés, intégrer des décompositions en sous-buts)

- projections selon le domaine pour trouver des sous parites indépendantes

- filtrage de raisons non autorisées, de buts non pertinents: cett eopération

pourrait être étudiée pour savoir si la suppression d'un argument change les décisions

- liens avec les opérateurs de changement de croyances (révision/mise à jour

selon un certain point de vue).

- élicitation interactive de préférences afin de construire un BLA pour un

groupe: utiliser les techniques des plateformes interactives d'argumentation

pour créer un BLA consensuel de groupe. On peut s'intéresser à deux études:

- agréger des préferences et croyances au niveau de chaque individu,

créer des BLAs individuels et les fusionner en BLA collectif

- fusionner les préférences et croyances collectives pour construire ensuite

un BLA collectif directement.

- Cette étude peut amener à définir des protocoles de construction:

- on pourrait

également étudier la construction par duels successifs entre BLAs et comment

l'organisation de ces duels a une influence sur le BLA final.

- étudier le lien entre cette construction et la notion de partage équitable

dans la théorie de choix social computationnel, cela permettrait d'évoquer des

stratégies, la manipulabilité de la structure et l'équité.

- calculer l'impact potentiel d'un argument pour savoir si une information

doit être révélée ou non.

Références:

- Florence Dupin de Saint-Cyr, Romain Guillaume. Analyzing a Bipolar Decision Structure through Qualitative Decision Theory. In : KI - Künstliche Intelligenz, Springer, January 2017 (to appear).

- Florence Dupin De Saint Cyr, Romain Guillaume. Towards a transparent deliberation protocol inspired from supply chain collaborative planning. In : International Conference on Information Processing and Management of Uncertainty in Knowledge-based Systems (IPMU 2014), Montpellier, France, 15/07/2014-19/07/2014, Anne Laurent, Olivier Strauss (Eds.), Springer, CCIS 443, pp. 335-344, July 2014.

Encadrante: Florence Bannay.

L'objectif de ce stage est d'étudier comment un opérateur d'extrapolation: c'est

un opérateur qui permet de déduire les trajectoires les plus plausibles

expliquant un scenario peut être étendu afin d'éliciter les responsabilités. On pourra ainsi répondre entre autres à une

question du genre "Qui a tué le Wumpus?", en introduisant la possibilité de

faire payer des tests, on pourra aborder la question du prix à payer pour être sûr

de la réponse?

L'exemple du Wumpus est issu d'un jeu vidéo

"Hunt the Wumpus"

écrit par Gregory Yob en 1973, il fut repris comme exemple pour l'intelligence

artificielle par Michael Genesereth et développé dans le livre de Russell et

Norvig.

Le Wumpus world et une cave avec des pièces représentées par une

grille (dans "la chasse au Wumpus" le joueur pouvait se promener dans un

dodécaèdre mais les variantes ont simplifié ce domaine).

Une pièce est voisine avec 4 autres pièces au maximum : situées au nord, au sud, à

l'est et à l'ouest de cette pièce.

Dans une pièce il peut y avoir de l'or, une fosse ou un wumpus (on

considère ici une version simplifiée, dans le

modèle de Russel et Norvig, une brise passe dans chaque pièce voisine

d'une falaise et l'agent sent la puanteur du Wumpus depuis les pièces

voisines, il entend aussi des cris quand le wumpus est tué et Bump quand

il fonce dans un mur).

Dans notre version simplifiée, un agent ne peut faire que

l'une des trois actions suivantes :

L'agent ne peut pas aller dans la

pièce qui contient une fosse, l'agent peut prendre l'or s'il est dans la

pièce où est l'or, l'agent peut tirer sur le wumpus s'il est dans une pièce

voisine et s'il possède une flèche. Si l'agent passe dans une pièce occupée par un

wumpus vivant alors il meurt.

Un exemple de problème est représenté par le tableau suivant :

|

1 |

2 |

3 |

| 1 |

Agent |

fosse |

or |

| 2 |

|

|

Wumpus |

On sait que l'agent possède une flèche à l'instant initial, on sait

d'autres choses à différents instants, et on sait qu'à l'instant 5

l'agent est dans la pièce 1.1. en possession de l'or. On apprend que le

Wumpus est mort (cet ensemble d'informations à différents instants est

appelé scenario). On aimerait savoir si l'agent l'a tué.

Références:

- Florence Dupin De Saint Cyr - Bannay, Jérôme

Lang. Belief extrapolation (or how to reason about observations and unpredicted change). In : Artificial Intelligence, Elsevier, Vol. 175, pp. 760-790, January 2011.

- Florence Dupin De Saint Cyr -

Bannay. Scenario

Update Applied to Causal Reasoning . In : International Conference on

Principles of Knowledge Representation and Reasoning (KR 2008), Sydney,

Australia, 16/09/2008-19/09/2008, Gerhard Brewka, Jerome Lang (Eds.), AAAI

Press, pp. 188-197, September 2008.

Tous ces sujets peuvent être envisagés comme des pistes pour commencer un

travail de thèse.